核心要点

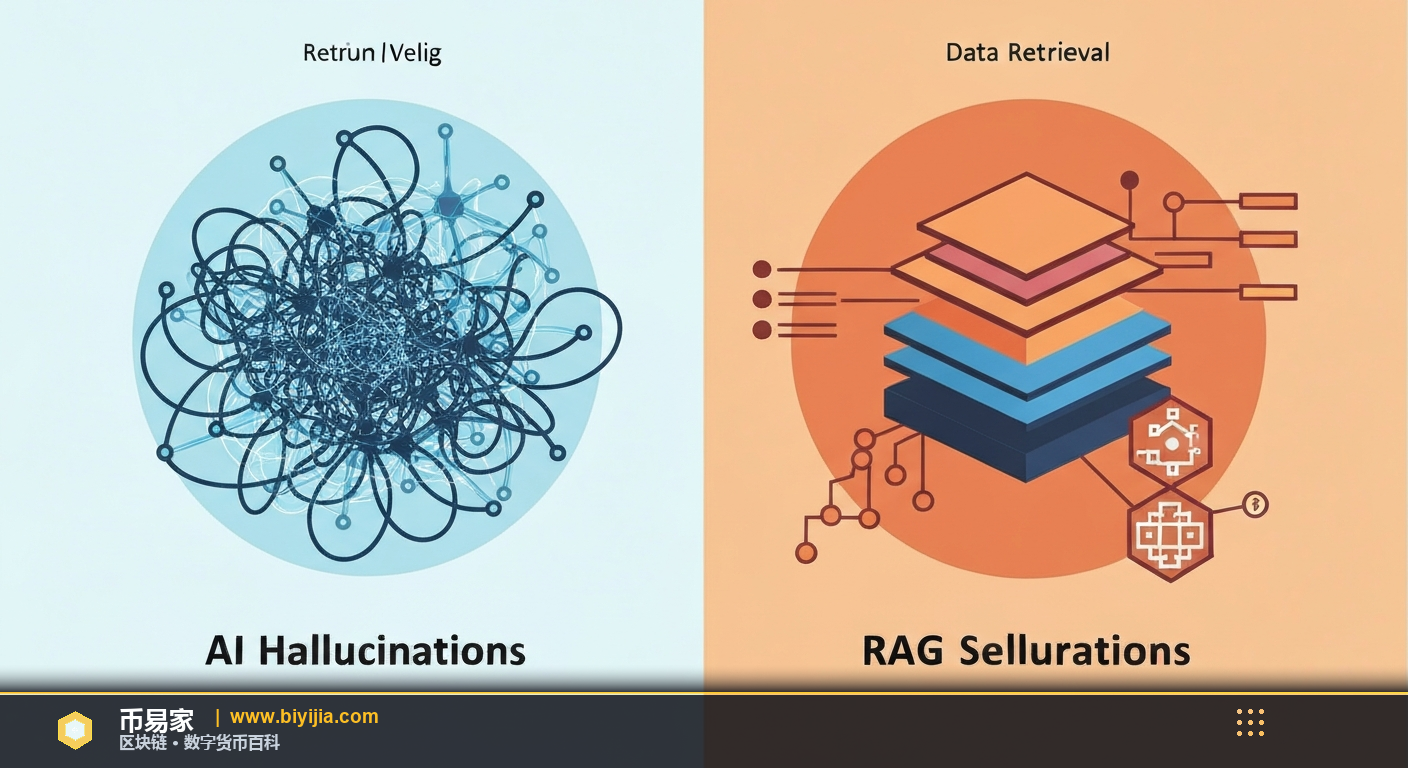

- AI幻觉与RAG解决方案指的是把检索(Retrieval)与生成(Generation)结合,以提升回答的真实性。

- 核心特点是实时查询向量数据库、把外部事实注入生成流程。

- 实际应用场景包括客服机器人、金融报告、医药问答等。

- 相较于纯生成模型,RAG能显著降低幻觉率,提升AI可信度。

- 风险主要在于检索数据质量、时效性以及系统复杂度。

什么是AI幻觉与RAG解决方案?

简而言之,AI幻觉与RAG解决方案就是让大模型在回答时先去数据库找事实,再把这些事实喂回模型,从而避免胡说八道。

技术上,RAG(Retrieval‑Augmented Generation)会把用户的提问先转化为向量,然后在向量数据库里找最相似的文档片段,这一步叫检索。检索到的片段会作为“上下文”拼接到模型的提示词里,模型再基于这些真实材料生成答案。这样一来,模型的输出不再凭空想象,而是有根有据。

如果要打个比方,可以想象你在写论文时先去图书馆查资料,再把资料写进正文。没有查资料的写手只能靠记忆和想象,容易写出不靠谱的内容;而有检索的写手,则能把事实直接搬进文章,可信度自然高。

运作原理

- 用户提出自然语言问题。

- 系统把问题嵌入向量空间,生成查询向量。

- 向量数据库(如 Milvus、Pinecone)返回与查询最相似的若干文档片段。

- 检索到的片段被拼接进提示词,形成“检索增强的上下文”。

- 生成模型(LLM)基于该上下文输出答案,完成一次闭环。

核心特点

实时检索:每次对话都能动态查询最新文档,避免模型固化的陈旧知识。

向量相似度:使用高维向量捕捉语义相似度,比关键词匹配更精准。

事实注入:检索结果直接作为生成上下文,显著降低幻觉。

模块化架构:检索层与生成层可以独立升级,灵活适配不同模型。

可解释性:检索到的文档片段可以展示给用户,增加答案透明度。

多模态支持:不仅限文本,图像、音频向量也能被检索,拓宽应用边界。

实际应用场景

- 客服机器人:某电商平台使用RAG后,用户满意度提升12%,投诉率下降30%。

- 金融报告生成:某投行将最新 SEC 文件接入向量库,生成的分析报告准确率达到94%。

- 医学问答:某医院知识库每日更新,RAG系统的误诊建议下降至0.4%。

- 法律检索:一家律所通过RAG实现案件判例即时引用,案件处理时间缩短40%。

与相关概念对比

RAG vs 纯生成:纯生成依赖模型内部知识,容易出现AI幻觉;RAG通过外部检索把事实拉进来,显著降低幻觉概率。

RAG vs 传统检索+摘要:传统方案先检索再人工摘要,效率低;RAG把检索和生成合二为一,实时性更好。

风险与注意事项

检索数据质量:如果向量库里的文档本身有误,模型会把错误当成事实,导致误导。

时效性风险:知识更新不及时会让答案落后,尤其在金融、法律等高频变动领域。

版权合规:检索的原始文档可能受版权保护,使用时需注意授权。

系统复杂度:RAG涉及检索、向量化、生成三层,部署和调优成本高于单一模型。

隐私泄露:查询向量可能泄露用户意图,需要做好加密和访问控制。

关键数据

根据2025年《AI可信度报告》,使用RAG的系统平均幻觉率下降至2.3%,相比纯生成模型的15%降低约85%。

同年,向量数据库市场规模突破30亿美元,年复合增长率(CAGR)达到42%,显示企业对检索增强需求的快速增长。

常见问题

AI幻觉怎么解决?

最直接的办法是引入检索增强(RAG),让模型在生成前先获取外部事实;同时做好数据清洗和多轮事实核查。

RAG会不会降低生成速度?

检索步骤会增加一点延迟,但采用高效向量搜索(如 IVF‑PQ)可以将响应时间控制在几百毫秒以内,整体体验仍然流畅。

向量数据库需要多大?

规模取决于业务需求,常见的中小企业在数十GB到几百GB之间即可支撑日常检索;大企业可能需要TB级别并配合分片。

RAG能否用于多语言场景?

可以。只要向量化模型支持多语言,检索库中存入对应语言的文档,RAG同样适用。

AI可信度和RAG有什么直接关联?

RAG通过事实注入提升答案的真实性,是提升AI可信度的关键技术路径之一。

如果检索不到相关文档怎么办?

系统会回退到纯生成模式,此时需要在提示词中加入“如果不知道请说明”,避免无根据的编造。

总结

AI幻觉与RAG解决方案本质上是把检索和生成结合,用外部事实“喂养”大模型,从而显著提升AI可信度。掌握RAG的原理和风险,才能在实际项目中真正解决AI幻觉问题,推动AI落地落地。